Table des matières

Lors de l’événement Cloud Next 2026, Google a levé le voile sur ses dernières avancées technologiques en matière d’infrastructure pour l’intelligence artificielle. Cette année, la multinationale met en avant sa huitième génération de TPU, accompagnée de nouvelles instances de GPU et d’améliorations significatives en stockage, pour répondre aux besoins croissants en puissance de calcul des agents d’IA. Découvrez comment Google s’engage à redéfinir l’avenir de l’intelligence artificielle avec ces nouvelles solutions.

L’essentiel à retenir

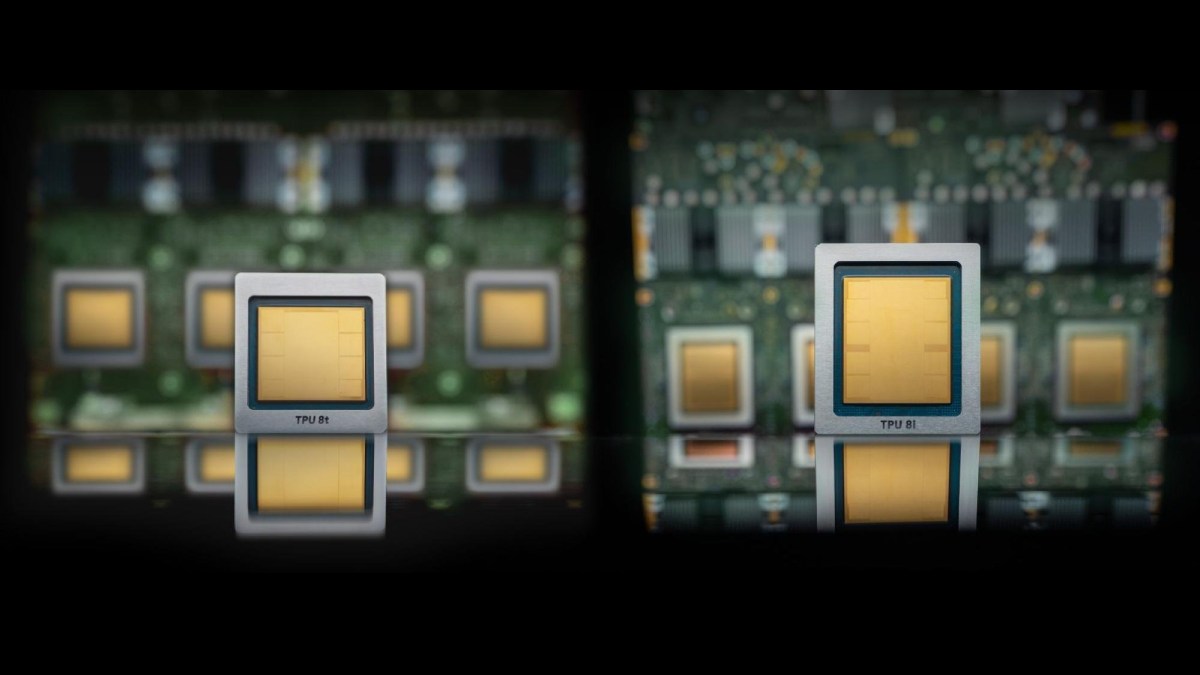

Lors de la conférence Cloud Next 2026, Google a dévoilé ses nouveaux TPU 8t et 8i, marquant une avancée majeure dans le domaine de l’infrastructure d’IA. Le TPU 8t, destiné à l’entraînement des modèles d’IA, offre une puissance de calcul près de trois fois supérieure à celle de la précédente génération, consolidée dans un superpod de 9 600 puces. Cette infrastructure impressionnante atteint 121 exaflops de puissance de calcul et dispose de deux pétaoctets de mémoire partagée.

Le TPU 8i, quant à lui, se concentre sur l’inférence et l’apprentissage par renforcement. Avec une augmentation significative de la mémoire et de la SRAM intégrée, ce modèle réduit la latence jusqu’à cinq fois, tout en améliorant l’efficacité du rapport qualité-prix de l’inférence de 80 % par rapport à ses prédécesseurs.

Google ne s’arrête pas là et propose également des améliorations considérables dans le domaine du stockage et des réseaux. Le nouvel outil Cloud Managed Lustre offre désormais une bande passante de dix téraoctets par seconde, une augmentation impressionnante par rapport à l’année précédente. Ces avancées permettent de répondre aux exigences de performance des applications d’IA en forte croissance.

De plus, avec le réseau Virgo, Google est en mesure de connecter jusqu’à 134 000 TPU dans un seul centre de données, et de dépasser le million de TPU répartis sur plusieurs sites, assurant ainsi une interconnectivité sans précédent.

Dans le cadre de ses annonces, Google a également révélé des améliorations apportées à Google Kubernetes Engine. Les nœuds peuvent désormais démarrer jusqu’à quatre fois plus rapidement, tandis que le chargement des modèles s’effectue cinq fois plus rapidement. Ces optimisations sont essentielles pour les entreprises cherchant à exploiter efficacement les capacités des agents d’IA.

Google positionne ses nouvelles avancées technologiques comme le socle de la plateforme Gemini Enterprise et des services associés. En intégrant ces innovations, Google entend offrir à ses clients des solutions robustes et évolutives pour développer des agents d’IA plus intelligents et autonomes.

En 2026, Google continue d’influencer profondément l’écosystème du cloud computing avec ses innovations constantes. Les améliorations apportées aux TPU et aux solutions de stockage démontrent l’engagement de l’entreprise à fournir des infrastructures puissantes et adaptées aux besoins des industries modernes. Dans un contexte où la demande pour des solutions d’IA performantes ne cesse d’augmenter, Google s’affirme comme un acteur incontournable.

Alors que la concurrence s’intensifie avec des acteurs tels qu’Amazon Web Services et Microsoft Azure, Google doit maintenir son rythme d’innovation pour rester en tête. La course à la suprématie technologique dans le domaine du cloud computing pousse ces géants à repousser constamment les limites, promettant ainsi un futur riche en opportunités pour les entreprises adoptant l’IA.